Apesar da revolução do Cursor e do Antigravity, o VS Code ainda é o único editor de código de que preciso para minhas tarefas de programação. Claro, ele não tem os mesmos recursos que os descendentes com muita IA, mas é o companheiro perfeito para minha configuração local. Na verdade, tenho usado desde que comecei a programar meus próprios aplicativos e, apesar de algumas pequenas peculiaridades, duvido que desista do VS Code tão cedo.

No entanto, meu antigo código VS começou a ficar lento ultimamente, e os recursos visuais extras que adicionei ao longo dos anos também não melhoraram nada. Então, reconstruí e reconstruí minha instância do VS Code para otimizar as configurações de codificação e acabou sendo a melhor decisão de produtividade de todos os tempos.

Configurei um servidor LLM local que posso acessar de qualquer lugar e usa um Raspberry Pi

Pode não substituir o ChatGPT, mas é bom o suficiente para projetos de ponta

Minha instância do VS Code tinha muitas extensões

Eu não precisei de metade disso para minhas tarefas de codificação

Com todos os contêineres de laboratório doméstico e máquinas virtuais que implanto por capricho, não deve ser surpresa que eu tenha armado o VS Code com mais extensões do que poderia precisar. Falando em linguagem, configurei diversos frameworks de desenvolvimento web, linguagens de consulta de manipulação de dados e extensões para Infraestrutura como Código. Mas eu usaria apenas uma linguagem específica (ou talvez duas) para minhas cargas de trabalho de codificação, enquanto o restante das extensões acumula poeira virtual em minha instância do VS Code.

No entanto, o verdadeiro inchaço das extensões veio dos recursos visuais e das ferramentas centradas em IA que instalei durante uma loucura aleatória. Eu tinha muitas extensões para mudar a aparência do VS Code, quando tudo que eu realmente precisava era de um formatador simples como o Prettier para tornar meus blocos de código estranhamente recuados mais fáceis de ler.

O mesmo vale para as extensões supostamente para melhorar a qualidade de vida que configurei no VS Code. Não me interpretem mal, ainda acredito que ferramentas de contêiner, Remote-SSH, Dendron e Live Server são essenciais para o VS Code. Mas, embora extensões como Trailing Spaces e Indent Rainbow possam ser facilmente replicadas usando configurações simples do VS Code, elas apenas tornaram o editor de código mais inchado, sem contribuir com nada útil para a tabela. E a situação era basicamente a mesma com minhas extensões centradas em IA.

Sua GPU antiga ainda pode executar grandes LLMs – você só precisa dos ajustes certos

Você pode fazer muito com esses padrões

A integração de LLMs nativos com VS Code aumentou minha produtividade várias vezes

E também removi as “funções” integradas do Copilot do meu editor de código

Embora o GitHub Copilot e seus concorrentes baseados em nuvem sejam ótimos para codificação de vibração, tendo a me ater aos meus LLMs locais para minhas falhas no VS Code. Os modelos auto-hospedados são perfeitos para minhas tarefas de codificação devido à sua privacidade e à falta de taxas de assinatura. Além disso, modelos como Gemma4-26B-A4B e Qwen3.6-35B-A3B podem competir com modelos típicos de computação em nuvem e funcionar incrivelmente bem com o VS Code em tudo, desde solução de problemas de logs de terminal e verificação de código em busca de vulnerabilidades até aplicação de modificações de fallback em arquivos de configuração e trechos de depuração. Como tal, as ferramentas Copilot que vêm com o VS Code são inúteis para mim e só podem adicionar opções adicionais no menu de contexto. Então eu os removi completamente em minha nova instância do VS Code.

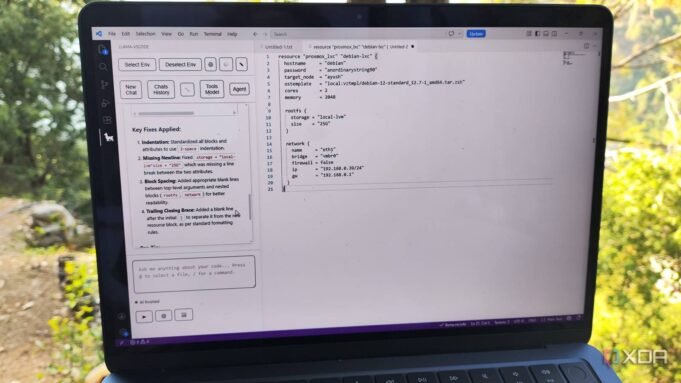

Infelizmente, a maioria das extensões orientadas para IA que encontrei no mercado concentravam-se principalmente em oferecer modelos proprietários (e cobrar assinaturas para usar a API), e os LLMs nativos foram mostrados apenas como uma reflexão tardia. Continue foi a única extensão de IA que usei no VS Code durante meses porque funcionou bem com meu LLM local, mas desde então mudei para lama-vscode. Crédito onde é devido, Continue foi ótimo em meus dias como um novo usuário do Ollama, mas comecei a confiar no llama-vscode quando mudei para llama.cpp como meu mecanismo de inferência. É claro que a interface um tanto desajeitada do lama-vscode pode demorar um pouco para se acostumar, mas é muito mais poderosa do que parece à primeira vista.

Como tenho diferentes pipelines LLM configurados nos nós do meu laboratório inicial, conectei o lama-vscode a modelos separados para preenchimento automático, incorporação e tarefas de bate-papo. A extensão lama-vscode funciona tão bem com dezenas de ferramentas em servidores MCP para meus utilitários FOSS.

4 bifurcações do VS Code projetadas para tarefas específicas

O VS Code clássico é ótimo e tudo, mas esses garfos especializados são melhores para certas tarefas de programação

Acontece que menos é mais quando se trata de extensões do VS Code

Por mais que eu adore mexer nas várias extensões do VS Code, era hora de me livrar do excesso de inchaço que assola meu editor de código. Além de algumas extensões e linguagens de codificação que melhoram a qualidade de vida com as quais costumo trabalhar, Prettier e lama-vscode são tudo que preciso para uma configuração eficiente do VS Code – uma que consuma menos recursos do sistema e não me distraia com elementos de interface do usuário inúteis.