O Pentágono e a empresa de tecnologia Google chegaram a um acordo para que o Departamento de Defesa use seus poderosos sistemas Gemini AI em redes classificadas, de acordo com um funcionário dos EUA familiarizado com o acordo.

Inscreva-se para ler esta história sem anúncios

Obtenha acesso ilimitado a artigos sem anúncios e conteúdo exclusivo.

O funcionário falou sob condição de anonimato porque não estava autorizado a divulgar detalhes do negócio. O conteúdo exato e os detalhes do novo acordo permanecem obscuros.

O acordo segue acordos semelhantes com outras empresas líderes de IA, incluindo OpenAI e xAI. O secretário de defesa, Pete Hegseth, tornou a adoção de IA uma prioridade máxima para as forças armadas. Uma promessa de transformar as forças armadas “Uma Força de Combate Al-First.”

Um porta-voz do Google não respondeu a perguntas específicas sobre o assunto O acordo, que foi relatado pela primeira vez pelo meio de comunicação de tecnologia Information.

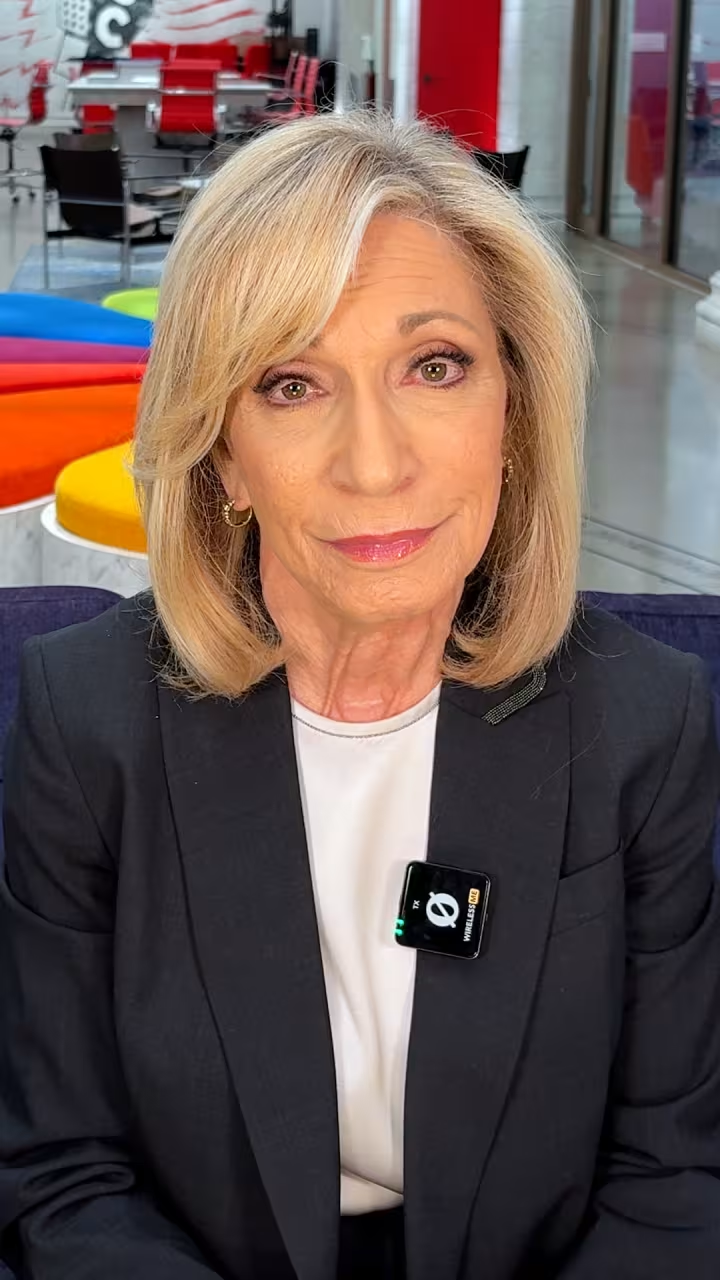

“Estamos orgulhosos de fazer parte de um amplo consórcio de laboratórios líderes de IA e empresas de tecnologia e nuvem que fornecem serviços e infraestrutura de IA para segurança nacional”, disse a porta-voz do Google, Kate Dreyer, à NBC News por e-mail. “Estamos comprometidos com o consenso dos setores público e privado de que a IA não deve ser usada para vigilância doméstica em massa ou armas autônomas sem supervisão humana apropriada”.

O Departamento de Defesa adotou a IA na última década, usando sistemas automatizados para tudo, desde Analisando imagens de drones na luta contra o grupo Estado Islâmico Simplificando a logística e Eliminar a disparidade salarial para os soldados. isso é Atualmente usando IA Análise de inteligência e fornecimento de apoio direcionado na guerra com o Irã.

“O acordo do Google para usar modelos de IA para fins confidenciais ilustra a crescente importância da IA para a segurança nacional dos EUA”, disse Michael Horowitz, ex-oficial sênior de defesa e atual professor da Universidade da Pensilvânia.

No entanto, Horowitz observou que os sistemas de IA do Google já estão sendo usados em sistemas não classificados, então “não é surpreendente que eles tenham chegado a um acordo sobre o uso classificado”.

Nos últimos meses, o Pentágono tentou negociar novos contratos com as quatro maiores empresas de IA dos Estados Unidos para incluir linguagem que permitisse “qualquer uso legal” dos seus sistemas de IA. O Pentágono anunciou contratos exploratórios iniciais com Google, OpenAI, Anthropic e xAI em julho.

Esses movimentos geraram alguma controvérsia, principalmente com a Antrópica. A empresa, liderada pelo CEO Dario Amody, procurou fortes garantias do Pentágono de que não utilizaria os modelos de IA da empresa para vigilância doméstica em massa ou controlo direto de armas letais autónomas.

Não está claro se o Google buscou tal garantia. Uma autoridade dos EUA que conversou com a NBC News disse que o acordo com o Google cobria usos legítimos do Departamento de Defesa.

paraAssinante

A ameaça de longo alcance da IA à segurança – e quais são os riscos

04:49

Embora o Google tenha evitado brigas públicas com o Pentágono, enfrentou alguma resistência por parte de seus próprios funcionários. Segunda-feira, Bloomberg News informou Que cerca de 600 funcionários do Google enviaram uma carta ao CEO Sundar Pichai instando-o a rejeitar a nova parceria de IA com o Pentágono.

Não é a primeira vez que o Google lida com a inquietação dos funcionários por trabalharem com os militares. Em 2018, milhares de funcionários do Google protestaram contra o papel da empresa num programa secreto do Pentágono chamado Project Maven. Gerenciado em parceria com a empresa de análise de dados Palantir, o Maven permanece Um dos principais programas de IA do Departamento de Defesa.

O Google decidiu não renovar o contrato do Project Maven Diante da oposição dos funcionários. Pichai disse na época que a agência não iria prosseguir com quaisquer aplicações de IA para “vigilância que viole as normas internacionalmente aceitas” ou para armas cujo objetivo principal seja “ferir ou ferir diretamente seres humanos”.

O uso de IA pelos governos na vigilância doméstica e no controle direto de armas automatizadas mortais tem sido áreas de particular atenção na indústria de IA e entre grupos da sociedade civil, embora isso tenha feito pouco para retardar os movimentos dos gigantes da tecnologia para adotar governos ou assinar contratos.

Essas preocupações se tornaram um debate público no início deste ano. Em uma postagem do blog no final de fevereiro Delineando essas duas linhas vermelhas, o CEO da Anthropic, Amodei, escreveu que “Em um sentido estrito, acreditamos que a IA pode minar, em vez de proteger, os valores democráticos. Alguns usos estão além dos limites do que a tecnologia atual pode fazer com segurança e confiabilidade”.

Depois de estabelecer um ultimato para a Antrópico cumprir os desejos do Pentágono de permitir o uso de IA para qualquer propósito legítimo – que pode exceder o âmbito aceite de utilização da Antrópico – Hegseth declarou o Antrópico um “risco da cadeia de abastecimento para a segurança nacional”, uma designação normalmente reservada a adversários estrangeiros. O Departamento de Defesa disse que vai estudar a redução do uso dos modelos da Antrópico nos próximos meses.

O presidente Donald Trump também anunciou no final de fevereiro Que ele proibiria todas as agências federais de usar os produtos da Anthropic, chamando a Anthropic de um grupo de “malucos esquerdistas”.

A Anthropic está processando o Departamento de Defesa e agências federais relevantes para reverter os decretos. O caso está dividido entre a Califórnia, onde um juiz suspendeu a transferência do sistema antropogénico, e Washington, D.C., onde o tribunal ordenou a suspensão preliminar de uma proibição semelhante.

Pouco depois de a Antrópica ter sido identificada como uma ameaça à segurança nacional, OpenAI anunciou que celebrou um acordo semelhante com o Pentágono para trazer seus modelos de IA para as redes confidenciais do Departamento de Defesa. No entanto, o anúncio foi recebido com protestos públicos sobre o potencial uso dos sistemas OpenAI pelo Pentágono, particularmente devido à aparente falta de salvaguardas em relação à vigilância dos americanos.

Como resultado, OpenAI e CEO Sam Altman Linguagem do contrato reformulada Poucos dias depois, o acordo atualizado especificava que nenhum dos serviços da OpenAI “seria usado para vigilância doméstica intencional de indivíduos e cidadãos dos EUA”.

Brian McGrail, conselheiro sênior do AI Security Center, disse em março que as agências de inteligência e de segurança nacional muitas vezes adotam uma interpretação muito liberal das disposições do tratado sobre vigilância. McGrail disse que, como estes acordos permanecem privados, muitas vezes é difícil avaliar a força das restrições à vigilância doméstica.